AIを使用するサービスも業法規制はAI利用者に帰属

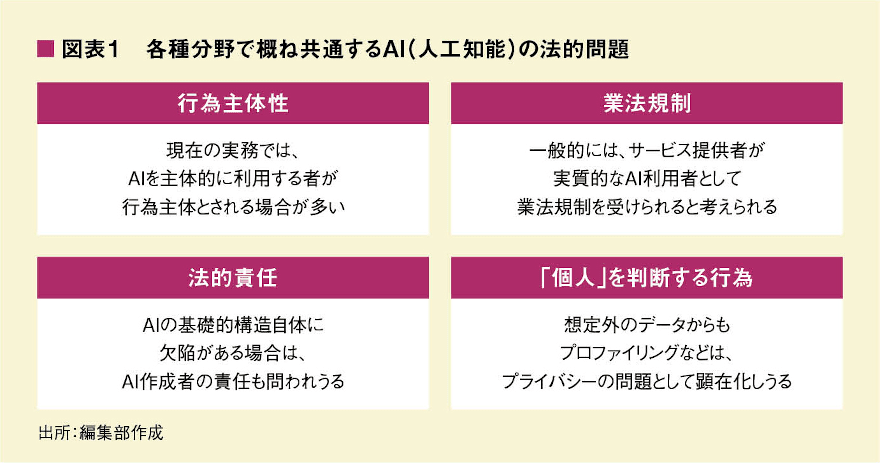

AIは各種の分野で利用されているが、ある程度、共通して生じる法的問題点を想定することができる。本項ではかかる法的問題を概観する(図表1)。

(1)行為主体性

AIが介在して何らかの行為が行われた場合、その行為主体が誰と判断されるべきかという点に関する問題である。AIそのものを行為者とする考え方や、AIの作成者やAIの利用者などを行為者とする考え方がありうる。この行為主体性が例えば、次の業法規制の問題や、AIによって生成された成果物の知的財産権の帰属などにも影響してくる(AI生成物の知的財産権は、法人化したAIに帰属させるべきという考え方も存在するが、それは、AIそのものを行為主体と見る考え方と親和性が高い)。とはいえ、現在の実務においては、AIを主体的に利用する者が行為主体とされる場合が多いと言えよう。

(2)業法規制

一定の行為を行う場合には、行政的規制、いわゆる業法規制が存在する場面が多い。例えば、次項で詳細に論じる金融・投資などは多くの業法規制が存在する分野であり、AIを診察に用いる場合なども同様である。このような分野においてAIを用いる場合、業法の適用をどのように考えるかという問題である。

(1)で前述したように、行為者をAI利用者と考えるのであれば、業法規制は、当該AI利用者に適用することになる。この場合、最終判断はあくまでもAI利用者が行っており、AIはあくまでもその判断の補助に過ぎないということになる。

なお、AIを利用させるサービスを事業者が一般向けに提供している場合、その利用の実態により差異はあるものの、一般的にはサービス提供者が実質的なAI利用者として業法規制の適用を受けると考えられる。次項の金融・投資に関する実例ではこのような考え方が前提とされている。

(3)法的責任

AIを用いて行った行為により、何らかの損害が生じた場合の責任に関する考え方については、自動運転などをはじめ、様々な文脈で論じられている。AIにおいて特にそれが問題となる理由は、法の原則的な考え方からすれば、行為主体であるAI利用者が責任を負うと考えられるところ、AIを利用した場合、本当にAI利用者に責任を問いうるかが問題となるからである。

AIは行為者の判断の補助を行うにすぎない、とする考え方を前提とすれば、そのような補助に基づき、行為を行った者が責任を負担することになろう。とはいえ、AIの基礎的構造自体に欠陥がある場合は、AI作成者の責任も問われうる。さらに、AIの内部がブラックボックス化している状況において、さらに技術進歩が進んでAIが作成者ですら想定していなかった自律的な判断を行うようになると、従来の責任分担の考え方が妥当か否か、という点も問題となる。

(4)個人への関与

次項記載のスコアリングなどもそうであるが、AIが過去のデータから個人の能力、傾向などに関し、一定の判断を提供することがある。このような場合、AIが個人を判断することをどの程度許してよいのかという問題が生じている。特に、ビッグデータに基づき、想定外のデータからプロファイリングが行われる場合などは、プライバシーの問題として顕在化しうる。信用データの算出などが問題となるのはそのためである。

(5)具体的な実用場面での検討

ここまで法的な問題点を抽象的に記載したが、次項では、金融・投資の現場で実際に行われているAIの利用場面に焦点を当てて、問題点を検討したい。

金融・投資業務におけるAI活用の法的問題

ここからは、AIと金融・投資について説明する。金融全般に関する説明は割愛し、金融・投資に関するAIの活用場面と、その留意点について詳述する。

(1)AIの利用主体と注文主体

投資業務に関して、AIは最終的には投資をする主体のために活用されるものであるが、そのAIのアルゴリズムを作成し、あるいはこれを作成する者に注文を行う注文主体は、必ずしも投資者とは限らない。自身が投資する場合でなければ、投資助言・運用を行う者としてこれを提供することになり、投資助言業務ないし投資運用業の規制(金融商品取引法第3章第2節第2款・第3款参照)が適用されることがありうる。

特に注文主体によるAIの利用を目的としない場合には、マス向けの投資商品となることが想定されるため、(金融商品取引法によるものとは別途、)投資家保護についてどのように考えるかが問題となる。

(2)AIと投資の類型

以上を踏まえ、本章では、エクイティとデット、投資者自身によるAIの利用の有無(マス向け商品かどうか)という観点から、マス向け商品のエクイティ投資を想定した投資アドバイス、マス向け商品のデット投資を想定したソーシャルレンディング、注文主体によるデット投資のために利用するAIとローン審査に分けて説明を行う。また、特殊な投資類型として、超高速取引についても取り上げる。

(2)-1 AIとロボットアドバイザー(投資アドバイス)

A. ロボットアドバイザーとは

ロボットアドバイザーとは、一定のアルゴリズムを前提に、これを処理するコンピューターが投資家のプロファイルに応じて自動的に資産運用を行うサービスである。

投資アドバイスに関しては、大きく、アドバイスだけ、例えばどういった投資商品が投資者に合うかを示すだけのものと、一定の方針に沿って運用まで行うものがある。これらを行うAIについて、(特に後者を指して)ロボットアドバイザーと呼ばれることが多い。

ロボットアドバイザーの活用のメリットとしては、個人の年齢や財産、投資意向・リスク許容度に応じて、投資に関するポートフォリオを組み、投資運用をすることが可能な点が挙げられる。

ロボットアドバイザーは、投資者のタイプを前述の年齢などの各要素に照らし、過去のデータと照らし合わせながら判断し、これに合った投資ポートフォリオを組んで運用をすることになる。投資ポートフォリオまでは自身で判断して、そのポートフォリオに合わせた運用だけをAIが行うものも考えられる。

B. ロボットアドバイザーと法規制

ロボットアドバイザーのうち、運用まで一手に担うものについては、投資一任契約に当たることから、投資運用業に該当する。運用まで行わないものであっても、投資商品の提案をするものであれば投資助言業務となるため、金融商品取引法に基づく登録を行った上で、一定の書面交付や説明義務の履践、適合性の原則の適用などの、金融商品取引法の適用がされる。

また、一定のファンドの募集に該当する場合には、原則として第二種金融商品取引業の登録が必要となる。

C. ロボットアドバイザーと法的責任

ロボットアドバイザーの利用者がこれにより損失を被った場合、提供者は法的責任を負うのか。これに関して、投資については自己責任の原則があることから、損失を被ったからといって提供者が責任を負うことは原則としてない。

しかしながら、ロボットアドバイザーの利用により確実に一定の利益が上げられるような説明をしていた場合には、断定的判断の提供、誤認勧誘に該当するとして、損害賠償の責任(金融商品の販売等に関する法律4条・5条)を負うことはありえる。過去実績を示すこと自体に問題はないが、将来の収益を約束するものではないことを示す必要があり、これは、ロボットアドバイザー以外での投資商品の販売の場合と同様である。

また、ロボットアドバイザーによる投資は投資一任であるため、その投資先や投資内容の詳細を投資者が知る必要はないものの、およそ損失を許容できない、あるいは投資について理解できない者に対しては販売してはならない。すなわち、投資商品の販売にあたっては、投資者の知識、経験、財産の状況及び投資目的に照らして不適当と認められる勧誘を行って投資者の保護に欠けることとなってはならず(金融商品取引法40条)、これに著しく反する場合には、提供者に対して不法行為(民法709条)に基づく損害賠償責任が生じることになる。

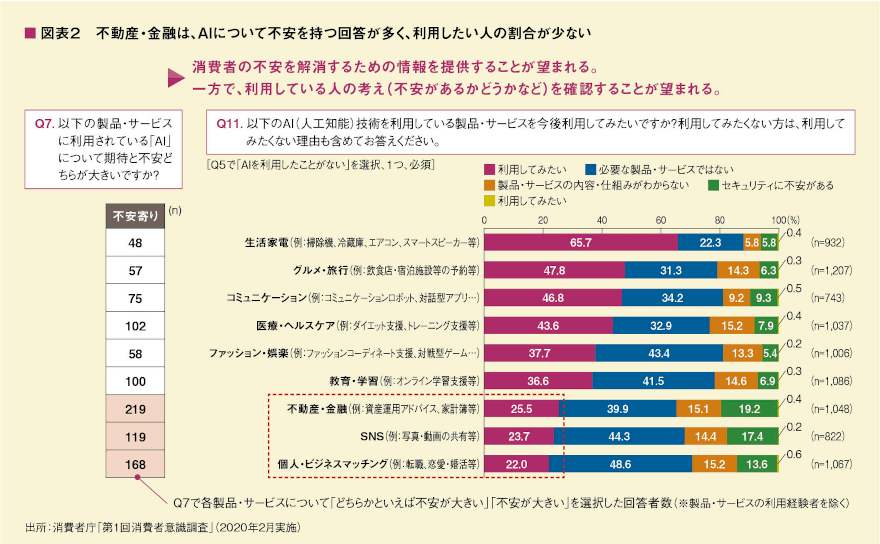

ロボットアドバイザーに関する説明義務を怠った場合も同様だ。投資者の知識、経験、財産の状況及び投資商品の販売に係る契約を締結する目的に照らして、当該投資者に理解されるために必要な方法及び程度による説明(金融商品の販売等に関する法律3条2項)を行わなかった場合には、提供者は損害賠償責任を負う(同法5条、民法709条)ことになる(図表2)。

以上は、個別の商品提供に関する義務違反の場合だが、プログラムエラー、アルゴリズムミスがあった場合にも、法的責任は生じうる。この場合、不法行為に基づく損害賠償責任(民法709条)が生じうるものと考えられ、損失との間の因果関係の有無や、過失の有無が問題となろう。法意としては、製造物責任法の範疇のようにも思われるが、同法における製造物とは、製造又は加工された動産を言うため、ソフトウェアやプログラム自体はその対象とはならないように解されており、基本的には上記の不法行為責任によることになろう。

(2)-2 AIと融資(ソーシャルレンディング)

A. ソーシャルレンディングとは

ソーシャルレンディングとは、ピアツーピアレンディングとも呼ばれ、一言で言えば、借主と貸主を結びつける融資の仲介である。大衆から資金を集め、これを資金の受け手が活用するクラウドファンディングとも類似するが、上記のエクイティとデットという大きな区分での差はある(個別の約定による)。ソーシャルレンディングにおいては、これをウェブ上で行うことにより、大量の借主と大量の貸主を結びつける機能を果たしている

B. ソーシャルレンディングと法規制

ソーシャルレンディングは出資ではなく融資に該当するが、反復継続して貸主と借主との間の仲介を行うことになるため、金銭の貸借の媒介で業として行うものに該当し、貸金業としての登録が必要である(貸金業法2条1項)。

また、不特定多数からの出資を集めて融資や出資の仲介を行い、運営会社が営業者として融資を取りまとめることから、匿名組合出資契約を募集するための第2種金融商品取引業の登録も必要になる。

C. AIを活用したソーシャルレンディングと法的責任

ソーシャルレンディングの利用者がこれにより損失を被った場合、運営会社は法的責任を負うのか。

これに関してもロボットアドバイザーと同様、投資については自己責任の原則があることから、損失を被ったから提供者が責任を負うことは原則としてない。適合性原則違反、説明義務違反、断定的判断の提供、誤認勧誘があった場合の不法行為(民法709条)に基づく損害賠償責任が生じうる点についてもロボットアドバイザーの場合と同様である。

一方、商品の性質上、貸付が回収不能となりうることについては、(本来エクイティ投資よりも弁済の順位としては優先されるものであるものの)一般に知れていることから、損失が生じたから直ちにこれらの責任を負うこととされる懸念は小さいであろう。半面、ソーシャルレンディング先の情報について故意・過失で誤った情報を伝えた場合には、その責任を負う。ただ、その情報については基本的には借主の自主申告によるものであり、裏付資料の提出を求めることができる情報であればその確認が可能だが、そうではない情報(たとえば他の借入れが無いとする申告)については、確認することが難しいこともあろう。

プログラムエラー、アルゴリズムミスがあった場合にも法的責任は生じうること、製造物責任法の適用が原則としてないことについても、ロボットアドバイザーの場合と同様である。

(2)-3 AIとローン審査

A. 金融機関のスコアリング審査とAI

金融機関のローンについては、住宅ローン、カードローン、アパートローン、中小企業向けローン、大企業向けローンなど、様々な取り扱いがある。

このうち、住宅ローンやカードローンについては、いわゆるスコアリングという方式が取られており、職業、年収、勤続年数、家族構成、持ち家か否か、 居住年数、健康保険の種類、銀行口座の種類、クレジットカードの有無、他社での借り入れ件数と金額などの要素ごとに、その内容をスコア化し、デフォルト確率とデフォルト時損失率から、貸出の可否・条件が決定されることになる。

このスコアリングについてはすでに一定の基準が確立されているものであるが、AIの活用により、デフォルト確率とデフォルト時損失率の精緻化の余地はあるように思われる(かかるコストと効果の如何により実際に活用されるか否かが決せられることになろう)。

B. AIを活用したローン審査と法的責任

AIを活用したローン審査と法的責任に関しては、まず、仮にAIを活用して行うローン審査に失敗があったとしても、損失を負うのはAIの活用者自身であるため、損失を被った主体から責任追及があるということは基本的には考えられない。

考えられるのは、AIの活用自体が適切でなかった場合に、活用した金融機関などの取締役が善管注意義務違反により任務懈怠責任等を負う可能性である。

この点、取締役の経営判断の適否が問われるのが通常であると思われるが、経営判断については、前提となる事実認識に誤りがあったり、判断が著しく不合理であった場合に任務懈怠となるものである。そうすると、AIの導入に関してコストに対する効果が小さいことが明らかであったり、AIのアルゴリズムに誤りがあることが明らかである、あるいは事後的に判明した誤りを放置するなどの不適切な対応を取っていたりした場合には、任務懈怠責任を負うことも考えられよう。

一方で、これらの事態が明らかであるとまでは言えず、あるいは判明した段階で適切な対応が取られていれば、取締役の善管注意義務違反による任務懈怠責任までは負わないものと考えられる。

また、多くは法的責任を負うことまではないと考えられるが、そのローン審査の仕組みにおいて人権的な問題が生じることもある。たとえば女性であることだけを理由として男性よりもローン審査が厳しくなる、あるいは融資条件が悪くなるなどの場合には、性差別を禁じる憲法に反するものであり、大きな問題が生じるであろう。

- 寄稿

-

弁護士

笹川 豪介 氏弁護士・LINE Pay/LVC株式会社セキュリティ室長。

「AIスコアサービスの可能性と倫理的諸問題への対応」

(金融法務事情2123号)、『AIビジネスの法律実務』(共著、日本加除

出版、2017年)等著作・論文多数。

- 寄稿

-

虎ノ門南法律事務所

弁護士

上沼 紫野 氏知的財産、IT、その他国際取引に関する分野を中心に業務を行う。

主著:「AIビジネスの法律実務(2017年日本加除出版)」

「著作権法実戦問題(2017年日本加除出版)」(いずれも共著)